AIエージェントとは?

AIエージェントとは?

2025/09/17

AIエージェント

とは?

科学の目でみる、

社会が注目する本当の理由

AIエージェントとは?

AIエージェントとは、課題解決のため、自律的に情報を獲得し、推論を行い、アクションを生成するAIです。大規模言語モデルや大規模マルチモーダルモデルの知的機能を基盤として、人や他のAIエージェントとも協力してさまざまな「アクション」を実行します。ネットワーク上のいわゆるサイバーな環境だけでなく、現実世界のフィジカルな環境を含めたサイバー・フィジカル環境で、さらに活躍する場が増えていくと期待されています。

大規模言語モデルや大規模マルチモーダルモデルを頭脳として持つAIエージェントが、人間のように振る舞う社会の到来や、さらに進化したAGI(汎用人工知能)やASI(人工超知能)が人類の存続を脅かすと警鐘を鳴らす予想が、専門家から発表され話題になっています。過剰な期待と悲観が語られて混乱しがちな今、最前線で研究開発や研究プロジェクトの立案に取り組む人工知能研究センター(AIRC)と情報・人間工学領域研究企画室に属している叶賀卓 企画主幹に、AIエージェントの現在地、課題や展望を聞きました。*1

AIエージェントとは

AIエージェントの基本概念

AIエージェントとは、大規模言語モデル(Large Language Model: LLM)、もしくは大規模マルチモーダルモデル(Large Multimodal Model: LMM)の知的機能を基盤として、課題解決のために自律的に情報獲得から推論を経て、アクションを生成するAIです。

(「大規模言語モデルとは? 」)

「1.置かれている状況を分析する」

「2.必要な手段を選択する」

「3.柔軟に行動する」

「4.学習改善を行う」

という4つの要素を備え、それらすべてを課題への対応に向けて自律的に遂行します。必要に応じて、現在一般にも広まっている生成AIも手段の一つとして使いながら、より広く、さまざまな種類のタスク達成を目指すものです。既存の生成AIは「生成したコンテンツの品質や創造性の良し悪し」で評価されますが、AIエージェントは「目的を遂行できたかどうか」が最終的な評価のポイントになります。

AIエージェントが注目される理由

これまではAIエージェントが情報を取得しようとしても外部システムの規格がさまざまでアクセスできなかったり、取得したデータの規格が違ったりして合わせられないという課題がありました。しかし最近、「モデル・コンテキスト・プロトコル(MCP)」という情報流通の手順やルールを定めたプロトコルが開発・公開されたことで、AIエージェントが異なる情報源を活用できるように、各社がデータやサービスをMCPの規格に合わせる動きが生まれています。技術の進展でAIエージェントが実現に向かい始めているのです。

活用が期待されている領域

「AutoGPT」や「Microsoft Copilot」といったアプリケーションは、ユーザの指示に従ってWeb検索、情報収集、コードや文書の生成、要約を行ったり、業務の効率化・自動化を支援したり、複数のアプリを横断してメールの自動返信やカレンダーへの登録までを行うことができるようになっています。サイバー空間上で完結する業務改善などには、AIエージェントが活用され始めていると言えるでしょう。

今はまだ実現できていませんが、今後、活用が期待される領域として、産総研は次の4つに着目しています。

1.協働ロボット

工場などの就労現場で、人や周囲の状態を認識して行動を最適化し、人のアシストをするロボットです。「フィジカルAI」という言い方もされるもので、フィジカルな実世界で、AIが生成した行動をロボットが代替し、人の代わりに動くことや人と協働することが期待されています。

2.スマートシティ

人を含めた都市の複雑なシステムの統合・最適化に、AIエージェントの活躍が期待されています。例えば、信号がない横断歩道で子どもが飛び出したとき、その情報がデータとして周囲を走る車に届き、回避させるといったことが自動的に行われるイメージです。

3.暮らし支援

家庭内でAIエージェントが「パーソナル執事」のように個人に合わせて生活を支援したり、家事などのタスクを自動化したりすることが期待されています。「さっぱりしたものが食べたい」といった曖昧な依頼からでも、その人の好み、冷蔵庫にある材料の量や状態から、料理を自動的に選択する家庭用ロボットなどの研究が進んでいます。

4.医療・ヘルスケア

日本は超高齢社会となり、医療従事者が足りていません。この社会課題にもAIエージェントが期待されています。患者のデータを収集して服薬をリマインドしたり、病院に行くことを促したり、医師の最終判断に引き継ぐまでの一次診断や健康相談、患者の自己管理支援での活用が見込まれています。(産総研マガジン「医療AIとは?」 )

AIエージェントの技術動向

AIエージェント活用に必要な技術

AIエージェントを成り立たせているのは下記の3つの仕組みです。それぞれに関して要素技術の研究開発が進んでいます。

1.環境情報を取得する技術

AIエージェントが環境情報をセンサやAPIなどを通して取得できるようにする技術です。画像、音声、触覚、バイタルデータ、LiDARなどの、多様な情報形式のセンシング技術開発が盛んに進められています。(産総研マガジン「LiDARとは?」「ハプティクスとは?」「生体機能計測とは?」)

2.行動を調整するための技術

環境をセンシングした後、その環境に応じて情報を処理し、行動を調整する仕組みがAIエージェントには必要です。頭脳にあたる重要な部分であり、LLMやLMMといった基盤モデルの性能向上に向けた開発が進められています。

3.行った結果に応じて計画の更新をする技術

自分が出力したものをモデル自体が自分で評価し、取り込んでアップデートする「自己学習」、もともとある汎用的な基盤モデルに、解きたいドメインに合わせて追加でデータを与えて更新する「追加学習」という2つの手法で開発が進められています。

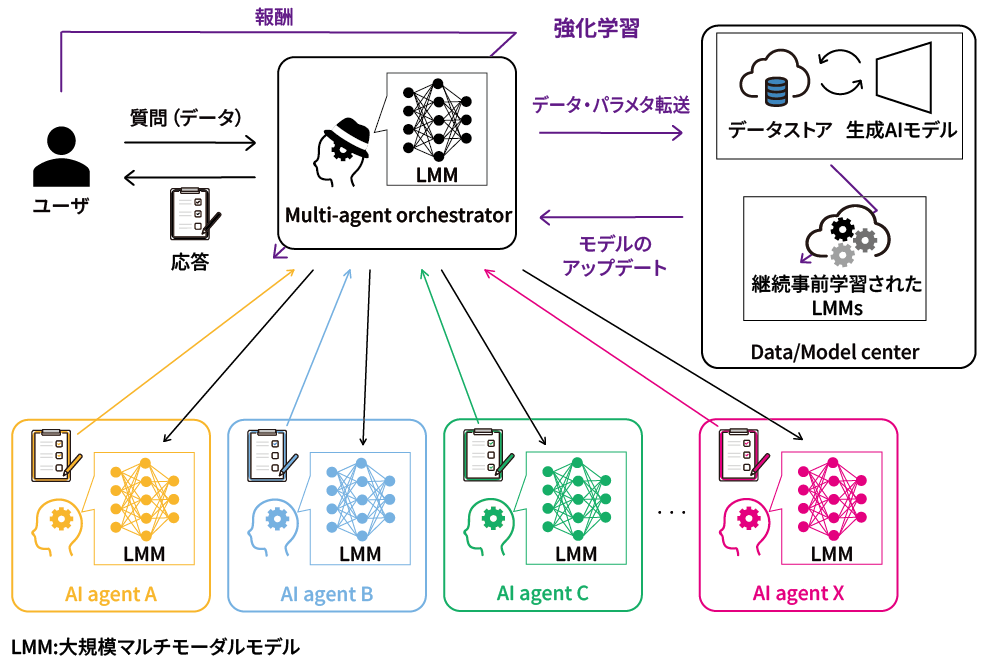

さらに、複数のモダリティデータを同時に取得し、統合・理解する「マルチモーダル化」のための技術、複数のAIエージェントの発言を調整する「オーケストレーション」技術の開発が活発に行われています。(産総研マガジン「マルチモーダルAIとは? 」)

複数のAIエージェントの発言を調整するオーケストレーション技術

複数のAIエージェントの発言を調整するオーケストレーション技術

解決が必要な技術的課題

世界中でさまざまな企業が開発に取り組んでおり、日々、進展している状況ですが、各社が向き合っている解決が必要な課題として代表的なものを挙げます。

1.長期的でマルチステップなタスク処理

情報を取ってきて、行動を決めて、実際に行動するという複数の段階があるマルチステップなタスク処理がAIエージェントには求められます。そのステップのどこかでエラーが起こると後続のステップがすべて失敗します。それぞれのステップでの精度を高め、タスクを首尾一貫して行えること、場合によっては「これはできなかったが、これならできる」と途中で調整する技術が必要で、基盤モデルの性能のさらなる向上が課題となっています。

2. 環境とのリアルタイム連携

実環境でAIエージェントが自然に振る舞うためには、「これをして欲しい」と伝えられてからすぐに答えを返す必要があります。フィジカル環境から得られるセンサやAPIの情報をスムーズに連携させるという課題があります。

3.ユーザへのパーソナライズと継続学習

AIエージェントは人のかなり近くにいる存在になるので、その人の嗜好や過去の行動を情報として保持する必要があります。しかも「先週はこれをしたけれど、今週はこれをした」と、常時、継続的に更新していかなければなりません。その人が常に満足できる身近な存在になるための、継続的な学習・改善の仕組みが課題です。

4.信頼性・安全性の保障

ユーザが意図しない動作や判断ミスがあった場合に、AIエージェントがなぜそのような出力をしたのかがブラックボックスになっていてわからないのではなく、意図理解ができるかは大事なことです。意図理解の精度向上やAIセーフティ対策は重要な課題です。(産総研マガジン「AIのセキュリティリスクとは?」)

5.複数エージェント・システムとの協調

1人のユーザに対して複数のAIエージェントが連携するときに、争うのではなく、情報を共有したり、役割を分担したりして協調する必要があります。エージェント間通信プロトコルや意思決定の合意形成、知識共有が技術的課題です。

6. 知識の正確性・最新性の担保

AIエージェントの知識が古いままでは、誤った判断につながります。情報として持っていても、古ければ反映してはいけないことを理解させなければいけません。今この瞬間の正しさに対応するために、リアルタイムで知識を取り込む技術や知識更新の自動化は課題です。

7. 倫理観の欠如や不均衡な価値判断

AIエージェントが人と密接に関わり、意思決定や行動を代行するようになると、「その判断が倫理的に正しいか」や「誰の価値観に基づいているのか」が問題となります。AIエージェントに公平性、操作性、説明性、文化的・社会的価値の扱いを与える技術が求められています。

社会的課題と解決への取り組み

AI活用に伴うプライバシー、倫理、法制度の面での課題は多く、社会的リスクを低減させるために、「AIセーフティ」についての取り組みが世界中で始まっています。英国や米国をはじめとして各国でAIセーフティ・インスティテュート(Artificial Intelligence Safety Institute:AISI)が設立され、情報の収集と枠組みづくりが行われています。日本でも2024年2月に関係府省庁・国立研究開発法人等が横断的に参画する機関としてAISI*2が設立されています。産総研はAISIパートナーシップ協定に基づいて、AIセーフティに関する評価・管理技術の研究開発、基準づくり、ガイドライン策定、国際標準化などで貢献しています。産総研の後押しにより2024年9月にAI品質マネジメントイニシアティブが発足し、民間企業間の互助を推進しています。

産総研の注力領域と今後の展望

基盤モデルの研究開発

産総研人工知能研究センター(AIRC)は、AIエージェントの頭脳にあたる基盤モデルの開発に注力しており、世界的にも先端を走っています。最近では、日本語能力を強化した大規模言語モデル「Llama 3.1 Swallow」、高性能な日本語音声基盤モデル「いざなみ」「くしなだ」、医療分野で高い診断精度を実現する画像基盤モデル、実世界の困難な作業に適用可能なロボット基盤モデルなどが発表されています。これからも世界トップレベルの成果を出すことを目指しています。

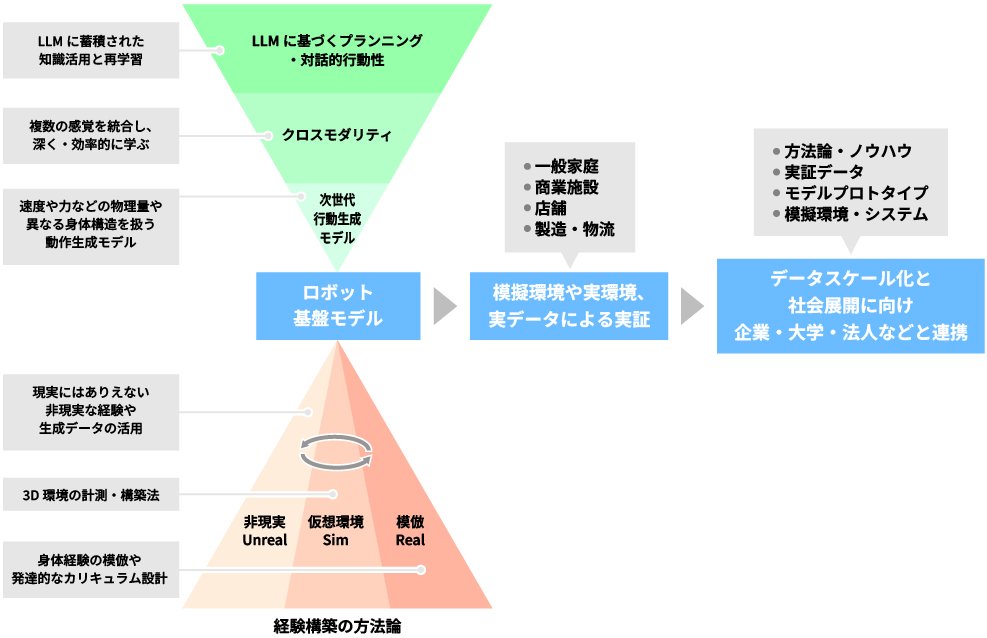

ロボット基盤モデルの研究開発アプローチ

ロボット基盤モデルの研究開発アプローチ

AIセーフティの研究開発

産総研インテリジェントプラットフォーム研究部門(IPRI)は、安全性の確保に向けた取り組みとして、生成AIシステムを開発・運用する企業に向けて、品質を実現するために行うべき事項を体系的に提示した 「生成AI品質マネジメントガイドライン」を2025年5月に発行しています。また、生成AIを適切に管理・利用するために必要となる安全性評価・管理技術の開発と、安全性基準の策定・標準化・普及を目的とした研究開発プロジェクト*3を進めています。

未来像と産総研の役割

これまでのAIシステムは単なるツールでしたが、AIエージェントは今後、数年で隣にいるパートナーや、代わりに何かをやってくれる代理人になっていきます。サイバー環境だけでなく、フィジカル環境でも活躍し始めるでしょう。ユーザのリテラシーはもちろん、多くの人がAIに関する知識を持ち、自在に操れることも大事になっていくため、AI人材の育成にも取り組む予定です。この人材の育成は探索的なフロンティアAI開発と国内外の人的ネットワークの形成により行われることを予定しています。

また、AIセーフティの重要性は、今後さらに表面化していくと予想され、産総研はAGI(汎用人工知能)やASI(人工超知能)までを視野に入れたセーフティ技術の開発や国際標準化に取り組んでいきます。

産総研は、世界最高水準の研究開発成果の創出、普及、活用の促進を期待されている組織として、フロンティアAI開発とAIセーフティ確保を両輪で進め、AIエージェントが信頼できるパートナーになる社会づくりを支えていきます。

*1: 本記事の作成には、人工知能研究センター濱崎雅弘副センター長、坂無英徳副センター長、インテリジェントプラットフォーム研究部門大岩寛副部門長、小西弘一統括研究主幹、川本裕輔グループ長が協力しています。[参照元へ戻る]

*2: AIセーフティ・インスティテュート (AISI)についてはこちら。[参照元へ戻る]

*3: 国立研究開発法人新エネルギー・産業技術総合開発機構(NEDO)「AIセーフティ強化に関する研究開発」 [参照元へ戻る]